مایکروسافت از مدلهای هوش مصنوعی Phi-3.5 رونمایی کرد؛ پیشرفت چشمگیر در برابر رقبا

- ۱۴۰۳/۰۶/۰۲

غول فناوری مایکروسافت با رونمایی از مدلهای جدید Phi-3.5، یک بار دیگر نوآوری خود را به رخ کشید. این مدلهای پیشرفته که ادعا میشود پیشرفت چشمگیری نسبت به رقبا دارند، نویدبخش تحولی بزرگ در حوزه هوش مصنوعی هستند. با این رونمایی، رقابت در این عرصه داغتر از همیشه شده و انتظار میرود کاربردهای هوش مصنوعی در آیندهای نزدیک به طور قابل توجهی گسترش یابد.

باتوجهبه نتایج بنچمارکها میتوان مدلهای Phi-3.5 را در برخی جنبهها رقیبی برای مدلهای گوگل و OpenAI دانست.

مایکروسافت اگرچه همکاری نزدیکی با OpenAI دارد، فقط به کار با این شرکت اکتفا نمیکند. غول دنیای فناوری بهتازگی از 3 مدل جدید Phi-3.5 رونمایی کرده که باتوجهبه نتایج بنچمارکها میتوان آنها را رقیبی برای مدلهای گوگل و OpenAI دانست.

براساس گزارش VentureBeat، مایکروسافت بهتازگی 3 مدل جدید سری Phi-3.5 را معرفی کرده است. هر 3 مدل برای دانلود از پلتفرم Hugging Face تحت مجوز MIT در دسترس هستند که امکان استفاده تجاری و تغییر بدون محدودیت را فراهم میکند. این 3 مدل به شرح زیر هستند:

- مدل Phi-3.5-mini-instruct با 3.82 میلیارد پارامتر.

- مدل Phi-3.5-MoE-instruct با 41.9 میلیارد پارامتر.

- مدل Phi-3.5-vision-instruct با 41.15 میلیارد پارامتر.

بنچمارک مدلهای هوش مصنوعی Phi-3.5 مایکروسافت

بهشکل شگفتانگیزی، هر 3 مدل در تعدادی از تستهای بنچمارک شخص ثالث عملکردی تقریباً عالی دارند، حتی در برخی موارد از سایر مدلهای هوش مصنوعی مانند جمینای 1.5 فلش گوگل، Llama 3.1 متا و حتی GPT-4o از OpenAI پیشی میگیرند. عرضه چنین مدلهای قدرتمند و متنبازی تحسین کاربران در شبکه اجتماعی ایکس را نیز در پی داشته است.

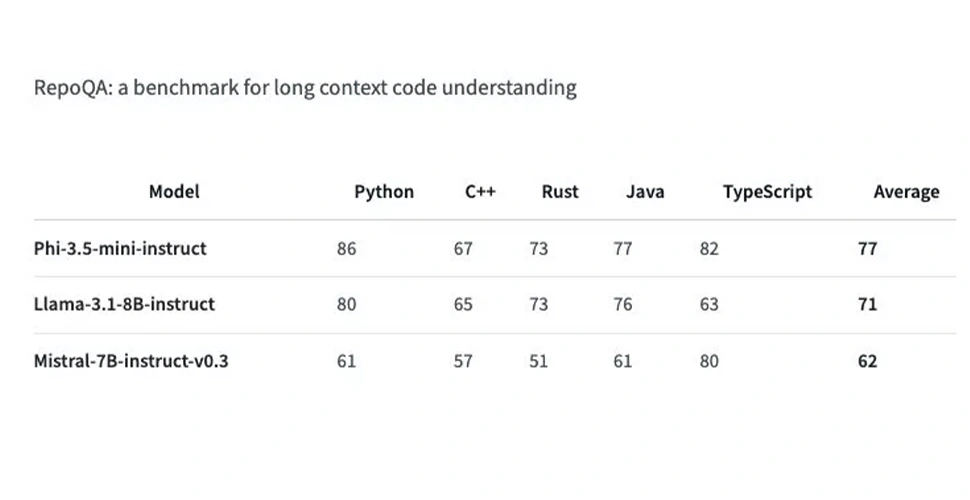

Phi-3.5 Mini Instruct مدل هوش مصنوعی سبک با 3.8 میلیارد پارامتر است که پنجره زمینه با 128 هزار توکن دارد. این مدل برای کارهایی که نیاز به قابلیتهای استدلال قوی دارند، مانند کدنویسی، حل مسائل ریاضی و استدلال مبتنی بر منطق ایدهآل است. مدل Phi-3.5 Mini Instruct باوجود اندازه کوچک خود، عملکردی تقریباً عالی در تعدادی از بنچمارکها دارد و از دیگر مدلهای هماندازه خود مانند Llama-3.1-8B-instruct و Mistral-7B-instruct در بنچمارک RepoQA جلو میزند.

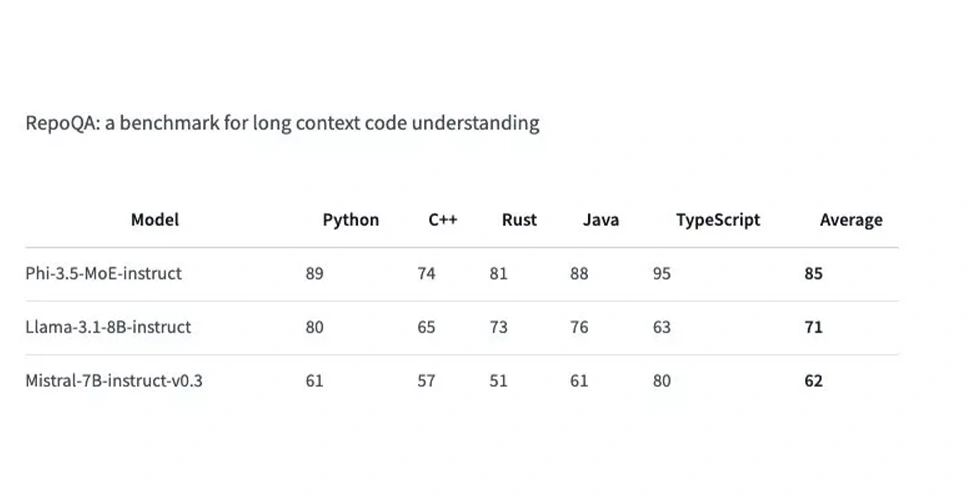

مدل Phi-3.5 MoE ظاهراً اولین مدل MoE (ترکیب متخصصان) مایکروسافت است. این مدل چندین نوع مدل مختلف را در خود ترکیب میکند که هرکدام در وظایف متفاوتی تخصص دارند. مدل جدید مایکروسافت از 42 میلیارد پارامتر فعال بهره میبرد و پنجره زمینه آن 128 هزار توکن است. این مدل بهطرز چشمگیری GPT-4o mini را در بنچمارک MMLU 5 در حوزههایی مانند STEM، علوم انسانی، علوم اجتماعی در سطوح مختلف شکست میدهد.

مدل Phi-3.5 Vision Instruct قابلیتهای پردازش متن و تصویر را ادغام میکند. این مدل چندوجهی بهویژه برای کارهایی مانند درک کلی تصویر، تشخیص کاراکترها، درک نمودار، جدول و خلاصهسازی ویدئو مناسب است. مانند 2 مدل قبلی، پنجره زمینه این مدل 128 هزار توکن است.

مدل Phi-3.5 Mini Instruct روی 3.4 تریلیون توکن با استفاده از 512 پردازشگر گرافیکی H100-80G طی 10 روز آموزش داده شده است، درحالیکه مدل Vision Instruct روی 500 میلیارد توکن با استفاده از 256 پردازشگر گرافیکی A100-80G در 6 روز آموزش دید. مدل Phi-3.5 MoE نیز که دارای معماری ترکیبی از متخصصان است، طی 23 روز روی 4.9 تریلیون توکن با 512 پردازشگر گرافیکی H100-80G آموزش داده شد.